A atual obsessão com listas de “profissões que a IA vai eliminar” não é um fato isolado. É a manifestação mais recente de um padrão histórico que a pesquisa (psicanalítica) identificou como “feridas narcísicas” – momentos em que novos conhecimentos abalam nossa percepção de centralidade e unicidade no universo. Como bem observou Dora Kaufman (O Globo, 21/06/2025) em artigo recente, a inteligência artificial generativa configura-se como a quinta ferida narcísica, questionando nossa penúltima fortaleza: a linguagem e a capacidade de processamento simbólico como distintivos exclusivamente humanos.

Cada ferida anterior provocou resistência similar. Copérnico nos retirou do centro do universo. Darwin nos colocou no contínuo evolutivo com outros animais. A psicanálise revelou que não controlamos nem nossa própria mente consciente. Uma quarta descontinuidade reconheceu a relação simbiótica entre humanos e máquinas. Agora enfrentamos algo qualitativamente diferente: sistemas que processam informação de forma estranha à cognição humana, mas com resultados que frequentemente superam nossa performance em domínios que considerávamos exclusivamente nossos.

A reação segue o roteiro familiar: negação (“IA nunca conseguirá fazer X, Y ou Z”), concessões graduais (“talvez faça tarefas simples, mas nunca as complexas”), e redefinição defensiva (“pode até fazer tudo isso, mas sem alma/consciência/verdadeira compreensão”). Este padrão revela menos sobre limitações da IA e mais sobre nossa dificuldade em processar mudanças que desafiam nossas autoimagens individual e coletiva. Essa natural resistência explica por que perdemos tanta energia mapeando cenários apocalípticos de substituição ao invés de explorar de um lado as oportunidades de amplificação de nossas capacidades, e de outro, os importantes riscos que precisam ser mitigados, que são muitos e alguns de alto impacto.

A pergunta “quando meu trabalho será automatizado?” serve função defensiva: transforma ansiedade em problema técnico com cronograma supostamente previsível. É mais confortável imaginar um futuro em que “radiologistas serão substituídos em 2028” do que reconhecer que estamos navegando território sem precedentes. Mas esta abordagem ignora a realidade emergente de que profissionais que trabalham diariamente com IA desenvolvem capacidade imediata de identificar quando seus resultados “não fazem sentido”, mesmo sem conseguir articular precisamente por quê.

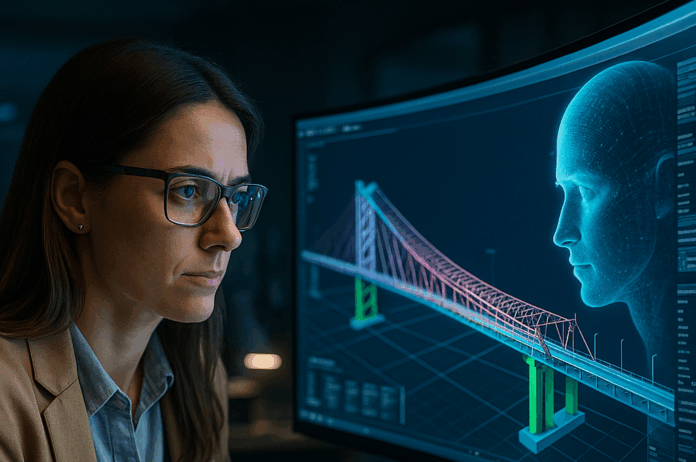

Esta intuição aponta para algo fundamental: o que emerge não são sistemas que substituem profissionais, mas o que abordei anteriormente em “Arranjos de Inteligências Artificial e Humana” – configurações colaborativas onde cada parte atua com suas forças distintivas. Na engenharia, isso significa, por exemplo, a IA acessando grandes bases de conhecimento, processando cálculos complexos, simulações e análises de dados, enquanto engenheiros definem parâmetros, interpretam resultados no contexto de sistemas maiores e assumem responsabilidade pelas decisões finais. Aponto o modelo apresentado no curso AI Fluency, recentemente lançado pela empresa Anthropic, e que oferece estrutura prática para navegar esses arranjos através dos “4Ds”: Delegação (saber quando e como transferir responsabilidades específicas mantendo comando estratégico), Descrição (articular problemas com clareza que permite colaboração produtiva), Discernimento (desenvolver julgamento sobre quando confiar em outputs versus quando questioná-los) e Diligência (manter responsabilidade contínua sobre resultados finais). Estes são princípios técnicos basilares que traduzirão as competências para inteligência amplificada.

Mas há algo mais relevante em jogo na discussão das feridas narcísicas. Muito ainda se discutirá sobre o que nos diferencia como humanos, o luto será longo. Mas o que precisamos cuidar para que continue uma fronteira entre nós e as novas formas de inteligência não é a questão cognitiva e sim no fato de que nós, humanos, somos portadores de direitos e deveres/responsabilidades intrincados em contratos sociais e civilizatórios elaborados ao longo de milênios. Somos agentes morais e legais, não apenas processadores de informação.

Esta distinção tem implicações práticas imediatas. Quando um engenheiro estrutural usa IA para otimizar um projeto, a ferramenta pode gerar soluções tecnicamente superiores, mas o engenheiro permanece responsável pela segurança pública, pelo cumprimento de normas, pela consideração de impactos ambientais e sociais.

A Inteligência Artificial pode calcular, mas não pode assumir responsabilidade civil ou criminal pelos resultados. Esta assimetria não é limitação técnica temporária ou uma burocracia mal pensada – é diferença fundamental de natureza. A IA não é imputável, não responde processo, não vai pra cadeia, não tem direito à vida, à liberdade, à igualdade, à segurança, à propriedade, não tem direito ao voto, de ir e vir, à organização partidária e não tem direito especialmente à liberdade de expressão. Independente da evolução da tecnologia, esses são pontos que, objetivamente, devem seguir nos diferenciando como humanos.

O trabalho, na sociedade contemporânea, transcendeu função econômica para tornar-se identidade primária. “Sou engenheira”, “sou arquiteto”, “sou médica” – profissões definem não apenas o que fazemos, mas quem Somos no tecido social. A possibilidade de substituição tecnológica ameaça esta construção identitária, mas a ameaça real não é a automação de tarefas, é a abdicação de responsabilidade. Profissionais que abordam IA como extensão de capacidades mantêm comando sobre seus domínios. Aqueles que a percebem como substituta externa praticamente garantem a própria obsolescência.

A boa notícia é que as feridas narcísicas anteriores seguiram padrão similar: resistência inicial, seguida de integração gradual que ao final expandiu ao invés de diminuir potencial humano. A revolução copernicana não tornou astronomia menos importante – revolucionou nossa compreensão do cosmos. A teoria evolutiva não diminuiu a biologia – fundou ciência moderna da vida. A quinta ferida narcísica possivelmente seguirá trajetória similar, mas com uma dimensão adicional: a necessidade de preservar e fortalecer os contratos sociais que definem nossa humanidade coletiva.

Superar esta ferida exige abandonar ilusão de unicidade cognitiva – não para diminuir o valor humano, mas para descobrir formas mais sofisticadas de amplificá-lo através de arranjos colaborativos de inteligências. Simultaneamente, exige reafirmar nossa posição única como agentes morais e legais responsáveis pelas consequências de nossas decisões amplificadas. O futuro da engenharia – e acredito que de outras profissões – não será de humanos versus inteligência artificial, mas de diferentes níveis de fluência em colaboração responsável entre formas complementares de inteligência.

Nos próximos anos alguns desenvolverão capacidade sofisticada de direção, julgamento e responsabilidade dentro desses arranjos. Outros permanecerão limitados por resistência narcísica ou complacência tecnológica. A responsabilidade pelas consequências da escolha precisa continuar nossa.

Mas por que penúltima? A última ferida seria reconhecermos uma IA como “pessoa”, com autonomia legal e responsabilidade própria. Nesse ponto, a fronteira entre criador e criatura se dissolve – e a viabilidade da humanidade entra em jogo. Um assunto pra desenvolver mais na próxima oportunidade.

Referências

Dora Kaufman. “IA e a quinta ferida narcísica”. O Globo, 21/06/2025. Disponível em: https://oglobo.globo.com/opiniao/artigos/coluna/2025/06/ia-e-a-quinta-ferida-narcisica.ghtml

Anthropic. “AI Fluency – Overview”. Disponível em: https://www.anthropic.com/ai-fluency/overview

George Paulus Dias. “Arranjos de Inteligências Artificial e Humana: rumo à qualidade e equidade na educação”. Instituto de Engenharia, 25/09/2023. Disponível em: https://www.institutodeengenharia.org.br/site/2023/09/25/por-george-paulus-dias-arranjos-de-inteligencias-artificial-e-humana-rumo-a-qualidade-e-equidade-na-educacao

________________________________________________________________________

* George Paulus Dias é engenheiro de produção pela Escola Politécnica da USP, mestre e doutor em Logística e Educação com Jogos. É empreendedor na área de sistemas de informação e educação. Acumulou 20 anos de experiência docente.

É conselheiro do Instituto de Engenharia onde também coordena o GT de Bioeconomia Nacional.